Die Zukunft der Softwareentwicklung 2027: Trends, die wir heute schon sehen

Ein Ausblick auf die technologische Landschaft in zwei Jahren – von KI-Agenten über WebAssembly bis hin zu neuen Paradigmen in der Cloud-Sicherheit.

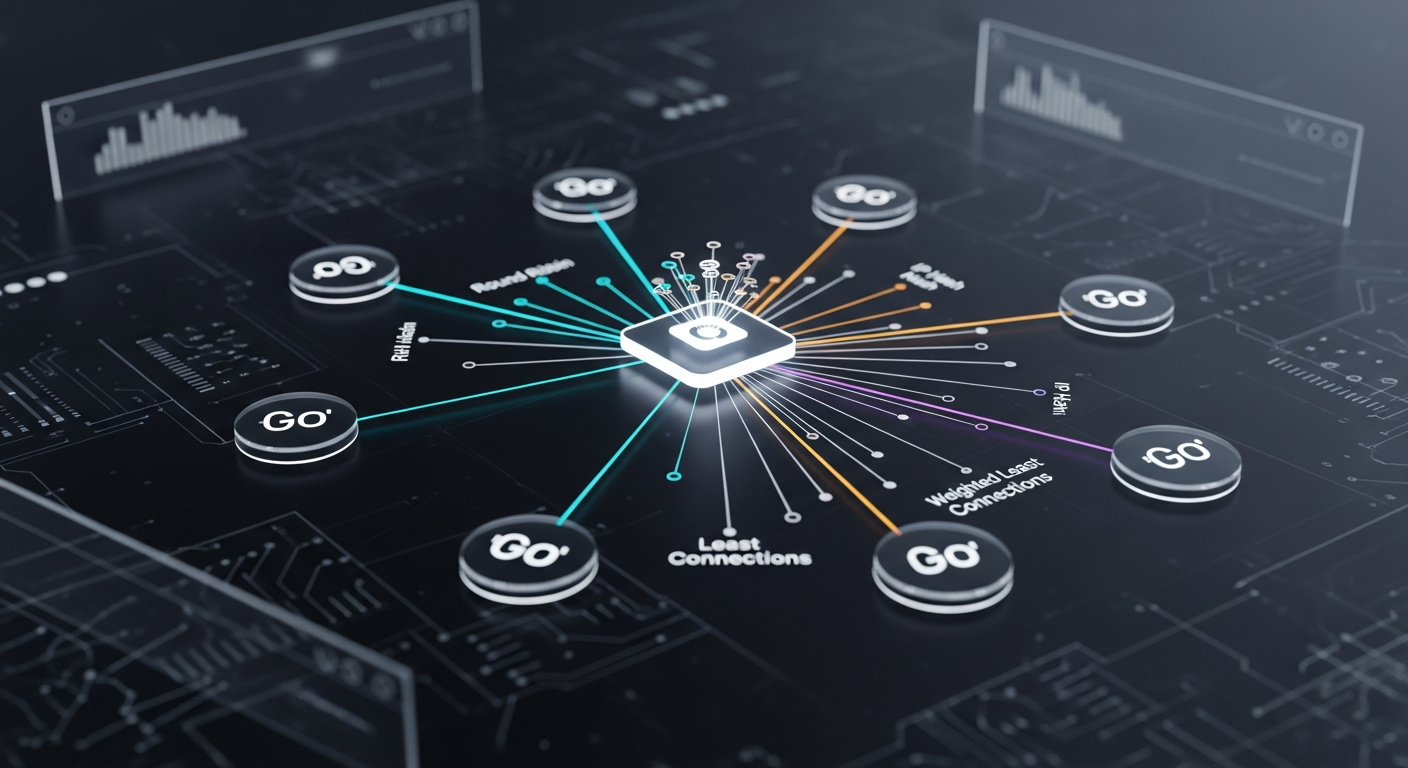

Ich vergleiche verschiedene Load-Balancing-Strategien (Round Robin, Least Connections etc.) und zeige, wie ich sie für skalierbare Go-Anwendungen implementiere.

Go-Anwendungen sind von Natur aus performant, doch selbst der schnellste Service stößt an seine Grenzen, wenn die Last zu groß wird oder ein Server hardwareseitig ausfällt. Um echte Enterprise-Stabilität zu erreichen, müssen wir unsere Dienste horizontal skalieren und den Datenverkehr intelligent verteilen. In diesem Beitrag zeige ich Ihnen verschiedene Load-Balancing-Strategien für Go-Microservices.

Die erste Entscheidung ist die Ebene, auf der die Verteilung stattfindet.

/api/v1 an eine andere Instanz-Gruppe als /api/v2.Wie entscheidet der Balancer, welcher Server die nächste Anfrage bekommt?

Anstatt Load Balancing in Go selbst zu programmieren, nutze ich meist bewährte Infrastruktur-Komponenten.

Load Balancing funktioniert nur, wenn der Balancer weiß, welcher Server gesund ist.

/health Endpunkt an. Dieser prüft nicht nur, ob der Webserver läuft, sondern auch, ob die Verbindung zur PostgreSQL-Datenbank und zum Redis-Cache stabil ist.Load Balancing ist kein nachträgliches Add-on, sondern muss bei der Architektur von Go-Backends von Anfang an mitgedacht werden. Durch den Einsatz von Health Checks und die Wahl der richtigen Verteilungs-Strategie schaffen wir Systeme, die nicht nur bei hohen Nutzerzahlen stabil bleiben, sondern auch Ausfälle einzelner Komponenten nahtlos überstehen.

Ist Ihre Go-Infrastruktur bereit für hohes Besucheraufkommen?

Ich unterstütze Sie bei der Planung von Hochverfügbarkeits-Szenarien und der Implementierung von Load-Balancing-Lösungen. Lassen Sie uns Ihre System-Resilienz erhöhen.

Ich unterstütze Unternehmen und Verbände bei der digitalen Transformation. Erfahre mehr über meine Softwareentwicklung oder lass dich im Bereich DevSecOps beraten.

Beratungstermin vereinbarenBleiben Sie auf dem Laufenden mit aktuellen Beiträgen zu DevSecOps, Webentwicklung, Smart Home und mehr.

Zum Blog

Ein Ausblick auf die technologische Landschaft in zwei Jahren – von KI-Agenten über WebAssembly bis hin zu neuen Paradigmen in der Cloud-Sicherheit.

Ein technischer Leitfaden zur Konfiguration von Streaming-Replikation in PostgreSQL, um die Ausfallsicherheit zu erhöhen und die Lese-Last zu verteilen.

Ich stelle meine Strategie vor, um IT-Dokumentation nicht veralten zu lassen, indem ich sie eng an den Entwicklungsprozess in Git anbinde.

Ich zeige, wie ich eine eigene, interne Certificate Authority (CA) aufsetze, um die Kommunikation zwischen Microservices mit TLS abzusichern.