K8s Chaos Battleship: Das Making-Of des unbesiegbaren Clusters

Ein detaillierter Blick hinter die Kulissen unseres interaktiven Chaos Engineering Experiments für die Cloudland 2026 – gebaut mit Go, FluxCD und viel Zerstörungswut.

Ein detaillierter Blick hinter die Kulissen unseres interaktiven Chaos Engineering Experiments für die Cloudland 2026 – gebaut mit Go, FluxCD und viel Zerstörungswut.

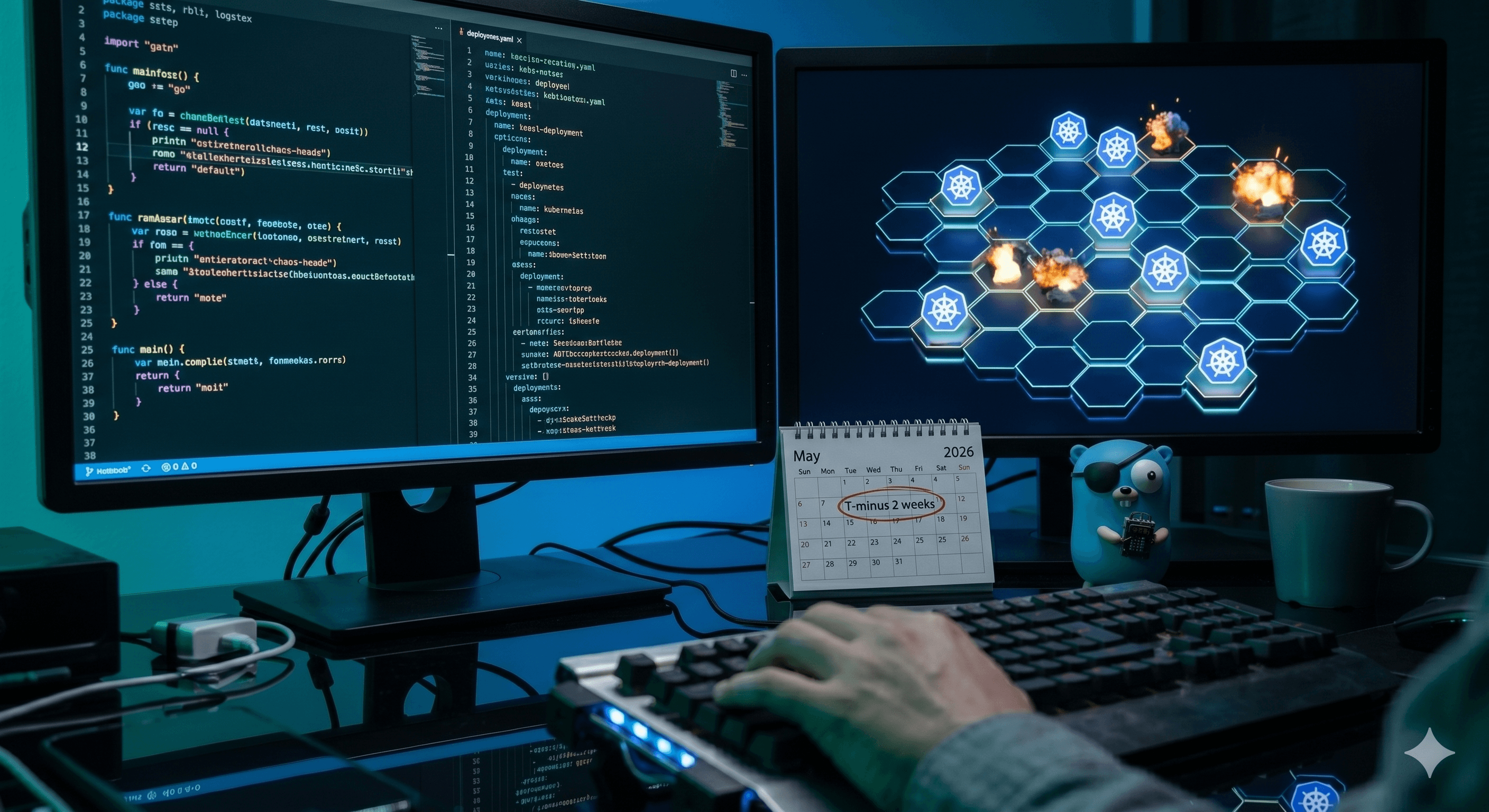

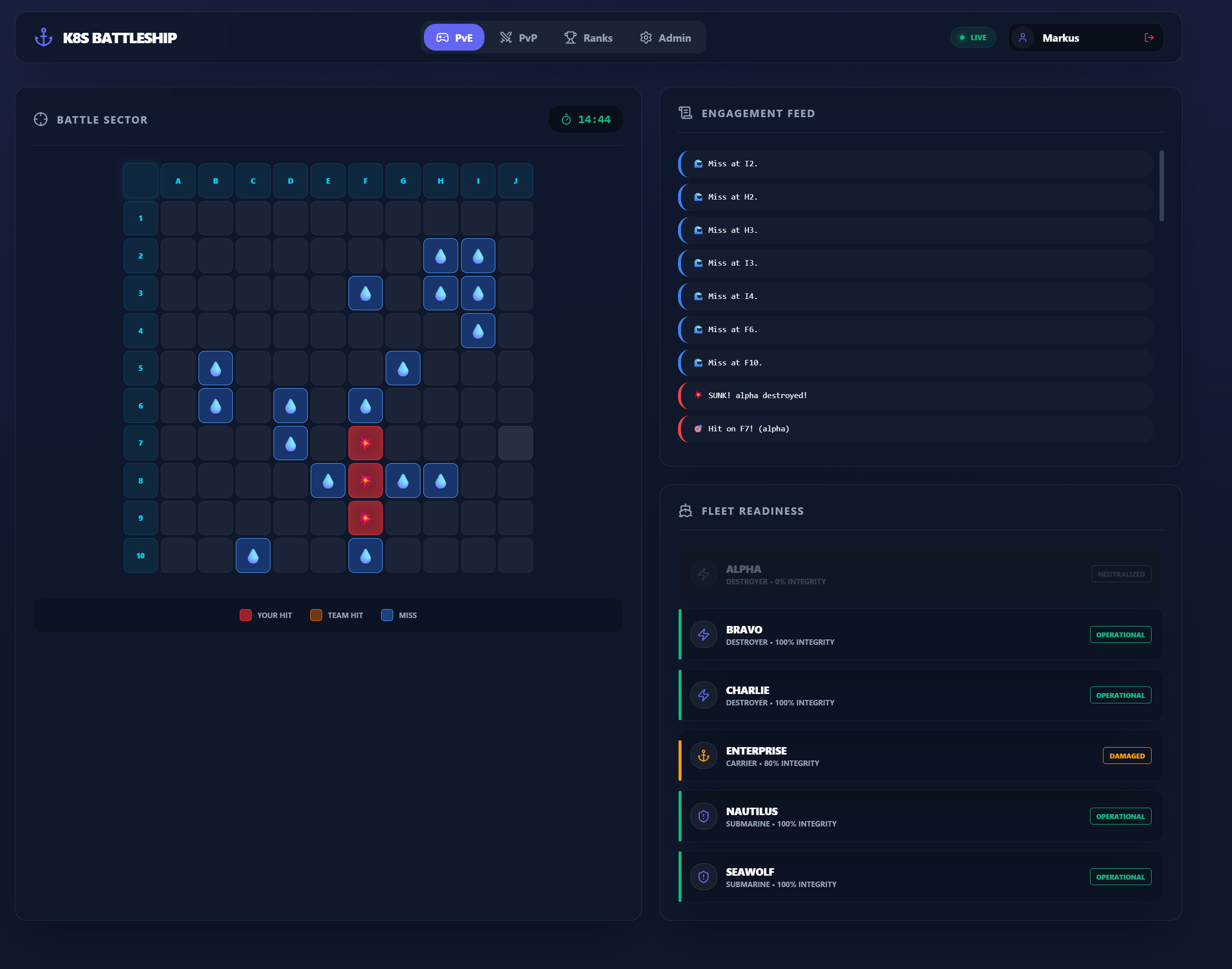

⏳ T-Minus 2 Wochen bis zur Cloudland 2026!

Die heiße Phase hat begonnen. Während auf meinem Kalender der Termin immer näher rückt, läuft das “Making Of” der Installation auf Hochtouren. Mein Dev-Desk ist ein Schlachtfeld aus Code-Editoren, YAML-Dateien und Performance-Monitoren. Aber das Game steht, und ich bin bereit, euch einen Blick unter die Motorhaube zu gewähren.

Hier ist das offizielle Making-Of meines Projekts, das beweist: Resilience kann verdammt viel Spaß machen.

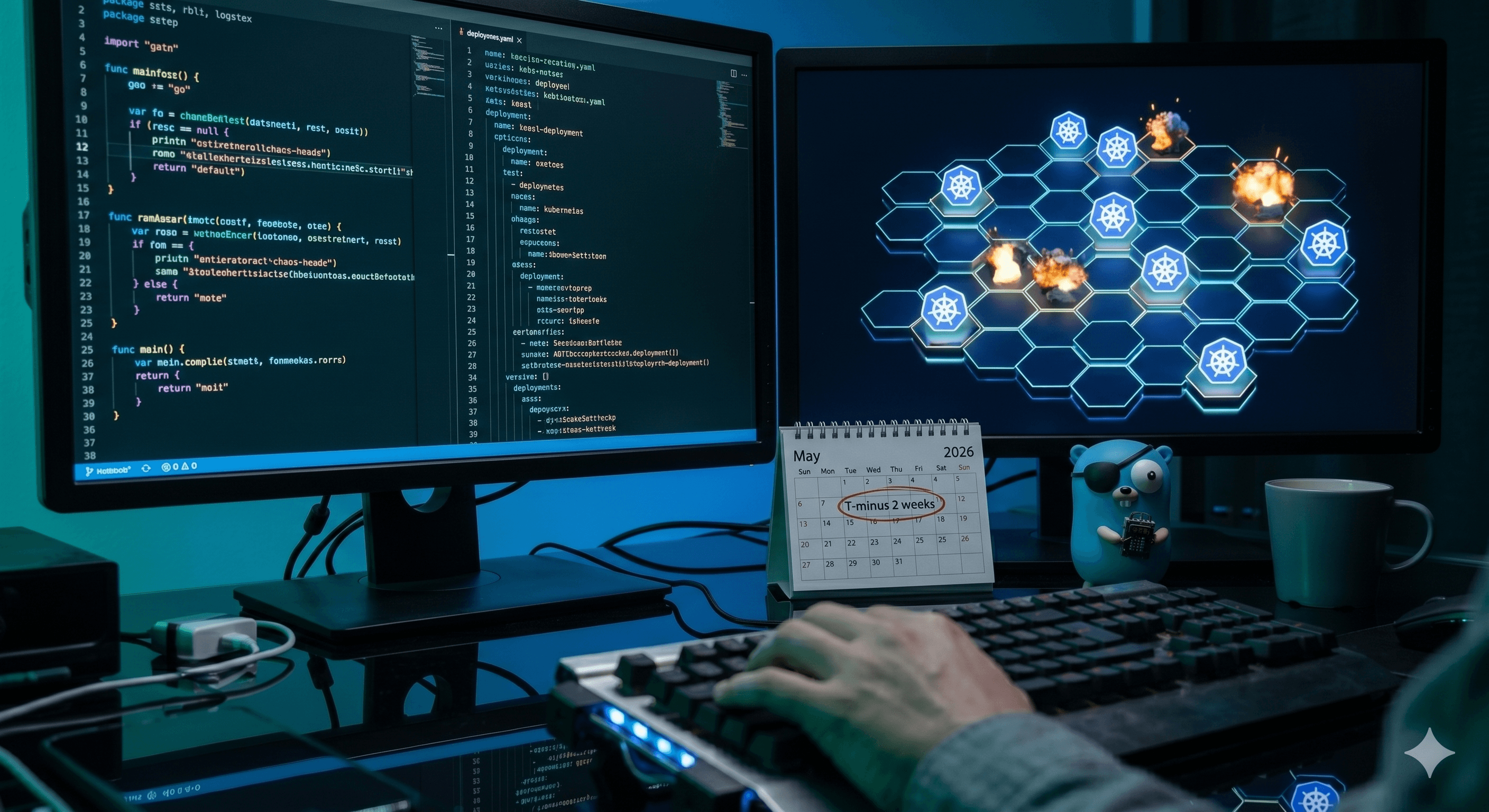

(Im folgenden Screenshot seht ihr die Benutzeroberfläche des Spiels)

(Im folgenden Screenshot seht ihr die Benutzeroberfläche des Spiels)

Der Grundgedanke war einfach, aber radikal: Chaos Engineering ist oft abstrakt und trocken. Ich wollte Plattform-Resilienz und Self-Healing nicht nur auf Folien erklären, sondern sie physisch erlebbar machen. Die Idee des “K8s Chaos Battleship” war geboren – ein interaktives Multi-Player-Spiel, bei dem die Teilnehmer über ihre Smartphones zu Angreifern werden.

Eure Mission: Zerstört unsere Infrastruktur. Meine Mission: Zeigen, dass eine moderne, GitOps-gesteuerte Plattform (unser “unbesiegbarer Cluster”) sich autonom gegen massiven Stress wehrt, ohne dass ein einziger Mensch eingreifen muss. Es ist der ultimative Proof of Concept für Platform Engineering.

Die Entwicklung des “Game Controllers” war der erste Meilenstein. Ich entschied mich für Go (Golang), da es die native Sprache von Kubernetes ist. Das ermöglichte mir, direkt auf die mächtige k8s.io/client-go Bibliothek zuzugreifen.

Das Backend-Konzept:

A5).DeletePod API-Call aus.Der Code-Editor auf meinem Monitor zeigt gerade die Feinheiten dieses “Zerstörungs-Algorithmus” – ich muss sicherstellen, dass die Zerstörung schnell genug ist, um FluxCD herauszufordern.

Die eigentliche Magie des Spiels liegt nicht in der Zerstörung, sondern in der Heilung (Reconciliation). Ich nutze FluxCD, um den “Desired State” unserer Schiffsflotte (die Deployments) im Cluster zu definieren.

Die größte Herausforderung im “Making Of” war das Tuning. Standardmäßige GitOps-Reconciliation-Intervalle von 30 Sekunden sind für ein Echtzeit-Spiel viel zu langsam. Das Spiel hätte sich “tot” angefühlt.

Ich experimentierte tief in den Konfigurationen von Flux, aggressiven Settings für Drift Detection und internen Requeue-Zeiten. Mein Ziel: Die Zeit zwischen einem API-gesteuerten Pod-Kill und der Erkennung des Drift-Status durch Flux zu minimieren. Nach viel Trial & Error erreichte ich, dass die Heilung (das Spawnen eines neuen Schiffsteils/Pods) oft innerhalb von 2-3 Sekunden visuell auf dem Screen sichtbar wird. Chaos tötet, GitOps heilt – im Sekundentakt.

Das Frontend, das ich den Teilnehmern auf der Cloudland präsentieren wollte, musste intuitiv und visuell ansprechend sein. Ich wollte kein Kubernetes-Dashboard, sondern ein Spiel.

Terminating zurück auf Running wechselt. Das Schiff baut sich visuell wieder auf.Die letzten zwei Wochen waren geprägt von massiven Lasttests. Ich simulierte 5000 gleichzeitige Angreifer pro Sekunde. Go zeigte hier seine extreme Stärke in der Nebenläufigkeit und Performance. Ich musste jedoch lernen, dass das Limit oft nicht unser Go-Code ist, sondern die API-Rate-Limits des Kubernetes API-Servers. Ich implementierte Queuing-Mechanismen, um den API-Server vor Überlastung zu schützen, ohne das Spielgefühl zu beeinträchtigen.

Die Installation steht. Die Pipelines sind scharf geschaltet. Mein Go-Gopher-Pirat (die physische Figur auf meinem Tisch) ist bereit, die Cloudland zu erobern.

Ich freue mich riesig darauf, euch in zwei Wochen zu zeigen, was “Resilience in Action” bedeutet. Trainiert eure Daumen. Kommt vorbei, zückt das Smartphone und versucht, unseren Highscore zu knacken. Wer schafft es, den Cluster wirklich in die Knie zu zwingen?

Wir sehen uns auf der Cloudland 2026!

Möchten Sie mehr darüber erfahren, wie ich mit Go und Flux komplexe Kubernetes-Betriebstools bauen? Besuchen Sie meinen Stand auf der Cloudland 2026 oder kontaktieren Sie mich direkt für eine Tech-Deep-Dive-Session. Lassen Sie uns gemeinsam über die Zukunft des Platform Engineering sprechen.

Ich unterstütze Unternehmen und Verbände bei der digitalen Transformation. Erfahre mehr über meine Softwareentwicklung oder lass dich im Bereich DevSecOps beraten.

Beratungstermin vereinbarenBleiben Sie auf dem Laufenden mit aktuellen Beiträgen zu DevSecOps, Webentwicklung, Smart Home und mehr.

Zum Blog

Ein detaillierter Blick hinter die Kulissen unseres interaktiven Chaos Engineering Experiments für die Cloudland 2026 – gebaut mit Go, FluxCD und viel Zerstörungswut.

Ein technischer Leitfaden zur Konfiguration von Streaming-Replikation in PostgreSQL, um die Ausfallsicherheit zu erhöhen und die Lese-Last zu verteilen.

Ich stelle meine Strategie vor, um IT-Dokumentation nicht veralten zu lassen, indem ich sie eng an den Entwicklungsprozess in Git anbinde.

Ich zeige, wie ich eine eigene, interne Certificate Authority (CA) aufsetze, um die Kommunikation zwischen Microservices mit TLS abzusichern.